目次

日本:AI推進法は「推進の司令塔+透明性」を法定化

日本は「人工知能関連技術の研究開発及び活用の推進に関する法律(AI推進法)」で、基本理念や基本計画、戦略本部の設置など、推進の枠組みを定めました。

この法律の最大の特徴は、AIを「経済社会の発展の基盤」と位置づけつつも、「国民の権利利益が害される事態」を防ぐための透明性確保を明文化した点にあります。

- AI戦略本部の設置:内閣に総理大臣を長とする「人工知能戦略本部」が設置され、国を挙げた総合調整が始まります。

- 安全性の確保:AIの不適切な利用による犯罪や人権侵害(個人情報の漏えい、著作権侵害など)を防ぐため、政府は必要な施策を講じる義務を負うことが定められました。

- 事業者の責務:AIを活用する事業者(活用事業者)に対し、事業活動の効率化だけでなく、国や自治体の施策への協力が求められます。

内閣府の説明では、令和7年6月4日に公布・一部施行、9月1日に全面施行(戦略本部設置規定等を含む)とされています。

EU:AI Actは「リスク4段階」+生成AIの透明性で実装義務を定義

EUは2024年8月1日に発効したAI Actで、禁止・高リスク・透明性リスク・最小リスクの4階層を整理し、高リスクにはデータ品質、ログ、文書化、人の監督、堅牢性などの要件を課します。

- 許容できないリスク(Unacceptable risk):人々の安全や権利に対する明らかな脅威とみなされ、禁止されます(例:ソーシャルスコアリング、リアルタイムの遠隔生体認証など)。

- ハイリスク(High risk):健康、安全、基本的人権に重大なリスクをもたらす用途(例:重要インフラ、採用活動、法執行など)。ハイリスクに分類されたAIシステムには、市場に出す前に以下の厳格な義務が課される。

- データ品質: リスクや差別的結果を最小限に抑えるための高品質なデータセット。

- ログ: 結果の追跡可能性を確保するためのアクティビティのログ保存。

- 文書化: 適合性を評価するために必要な情報の詳細な文書化。

- 人の監督: 適切な人間による監視措置。

- 堅牢性: 高レベルの堅牢性、サイバーセキュリティ、および正確性。

- 透明性リスク(Transparency risk):チャットボットやディープフェイクなど、人間がAIと対話していることやコンテンツがAI製であることを知る必要があるケース。

- 最小限のリスク(Minimal or no risk):スパムフィルターやビデオゲームなど、現在EUで使用されているAIの大半がここに該当し、追加のルールは課されません。

さらに2025年8月2日に適用された、汎用目的AI(GPAI)モデルに関する義務およびガバナンス規制では、透明性や著作権関連ルール、(能力や普及度によって)システミックリスクの評価・緩和などが説明されています。

2026年8月2日には、大部分の規制が適用されて全面的に適用となりますが、規制対象製品に組み込まれるハイリスクAIシステムに関する規制適用は、移行期間が長く設定されており、2027年8月2日に完全適用を目指すスケジュールになっています。

中国:生成合成コンテンツは「明示+暗示(メタデータ)」が本筋

中国(中国網信網/CAC)は2025年9月1日から「人工知能生成合成内容識別弁法」が施行されました。これは、AI生成コンテンツに対して「明示的」および「非明示的」な識別子の付与を義務付けるものです。

- 強制的なラベル表示:テキスト、画像、音声、動画のすべてにおいて、ユーザーが認識できる「提示ロゴ」や「注意書き」の表示が必須となりました。

- デジタル透かしの義務化:ユーザーには見えないメタデータや不可視の透かし(電子透かし)をファイルに埋め込むことも求められています。

豪州:単独のAI法より「既存法+AI Safety Institute」で機動対応

オーストラリアのNational AI Planは、AIによる危害を軽減するための「AI Safety Institute(AISI)」を設立しました。

- 危害の軽減:AIによる差別、プライバシー侵害、偽情報の拡散といったリスクに対し、既存の法規制(消費者保護法など)を適用しつつ、不足があれば新たな介入を行う姿勢を明確にしています。

- 高リスク分野への対応:特に医療や重要インフラにおけるAI利用について、厳格な審査と安全基準の策定が進められています。

米国:連邦“最小負担”の全国標準を志向し、州法のばらつきを是正へ

米国の大統領令(2025年12月11日)は、州ごとの過度な規制が「50のパッチワーク」を生み革新を妨げるという問題意識を示し、最小限の負担で全国標準を作るべきだと述べています。

同大統領令は、州AI法を争うための「AI Litigation Task Force」を司法長官が設置すること等も定めています。

韓国:AI広告のラベル義務を2026年早期に向け制度化

A韓国は、AIで作成・編集した広告(写真・動画等)へのラベル表示を求め、プラットフォーム側にも順守確保の責任を負わせる方向で、関連法改正により2026年早期の施行を目指すとしています。

まとめ:ビジネスへの影響と対策

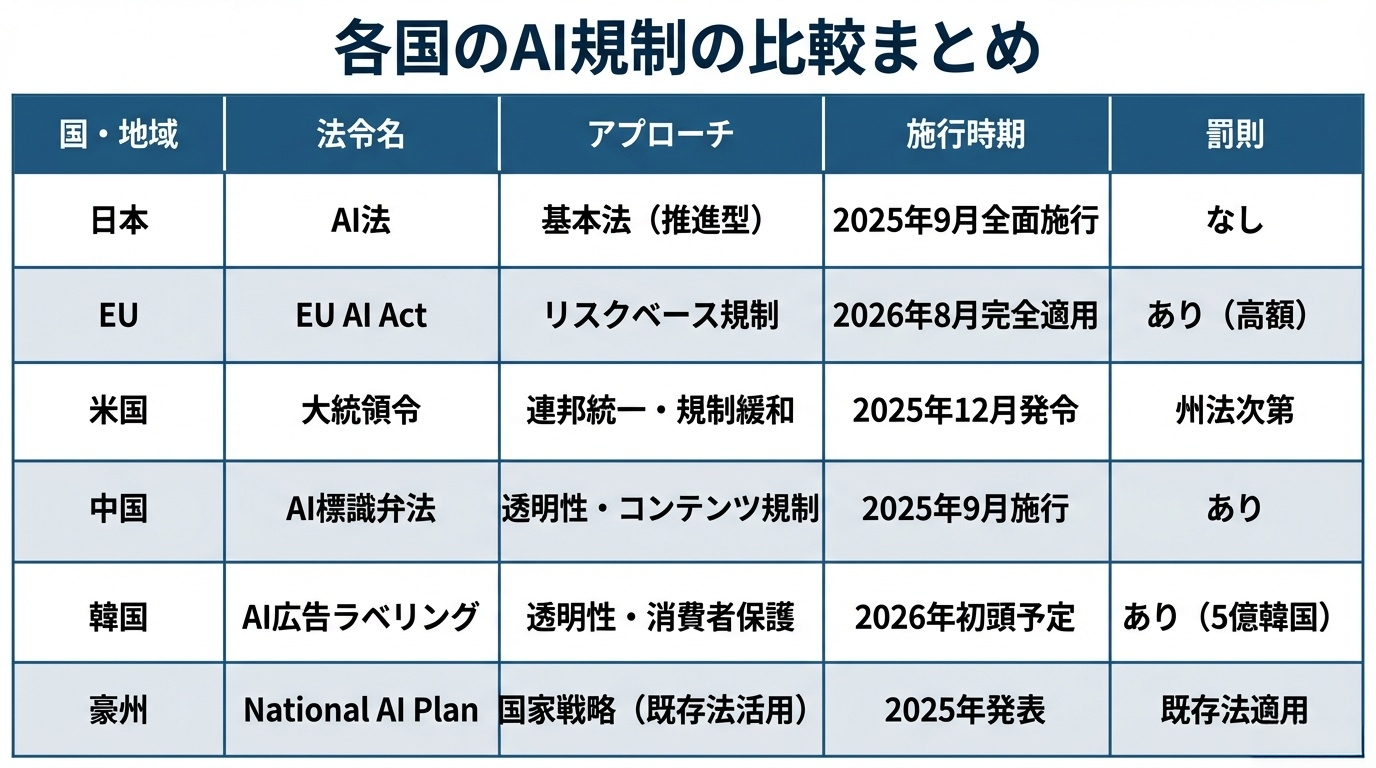

今回ご紹介した、各国のAI法を簡潔にまとめると、以下の通りとなります。

2025年の法規制ラッシュにより、日本企業は以下の対応を迫られることが分かります。

- 「AI生成」の明示: 中国や韓国市場を含むグローバル展開を行う場合、AI生成コンテンツへの「透かし」や「ラベル表示」はもはやマナーではなく法的義務です。

- リスク評価の定着: オーストラリアやEUのように、リスクベースのアプローチが標準化しています。自社製品が「高リスク」に該当しないか、事前の評価プロセスを確立する必要があります。

- 国内法への追従: 日本の「AI基本法」に基づき、今後策定される詳細な政省令やガイドラインを注視し、コンプライアンス体制を強化することが急務です。

“国ごとに作り直す”のではなく、共通の運用基盤を作り、必要な差分だけを上書きする。これが、AI法制の変化に負けない一番の近道と言えるでしょう。

参考・出典

本記事は、以下の資料を基に作成しました。

- The White House(https://www.whitehouse.gov/):ENSURING A NATIONAL POLICY FRAMEWORK FOR ARTIFICIAL INTELLIGENCE(2025年12月11日)(アクセス日:2025年12月15日)

https://www.whitehouse.gov/presidential-actions/2025/12/eliminating-state-law-obstruction-of-national-artificial-intelligence-policy/ - The European Commission(https://commission.europa.eu/index_en):AI Act(アクセス日:2025年12月15日)

https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai - The Associated Press(AP News)(https://apnews.com/):South Korea to require advertisers to label AI-generated ads(2025年12月10日)(アクセス日:2025年12月15日)

https://apnews.com/article/south-korea-label-ai-ads-deepfake-6df668ae93489da7d448c66e53905bbb - Australian Government Department of Finance(https://www.industry.gov.au/):National AI Plan(アクセス日:2025年12月15日)

https://www.industry.gov.au/sites/default/files/2025-12/national-ai-plan.pdf - e-Gov(法令検索)(https://laws.e-gov.go.jp/):令和七年法律第五十三号 人工知能関連技術の研究開発及び活用の推進に関する法律(アクセス日:2025年12月15日)

https://laws.e-gov.go.jp/data/Act/507AC0000000053/624018_1/507AC0000000053_20250901_000000000000000_h1.pdf - 内閣府(https://www.cao.go.jp/):人工知能関連技術の研究開発及び活用の推進に関する法律(AI法)(アクセス日:2025年12月15日)

https://www8.cao.go.jp/cstp/ai/ai_act/ai_act.html - 中国サイバースペース管理局ウェブサイト(https://www.cac.gov.cn/):关于印发《人工智能生成合成内容标识办法》的通知(2025年03月14日)(アクセス日:2025年12月15日)

https://www.cac.gov.cn/2025-03/14/c_1743654684782215.htm

AI利用について

本記事はAIツールの支援を受けて作成されております。 内容は人間によって確認および編集しておりますが、詳細につきましてはこちらをご確認ください。